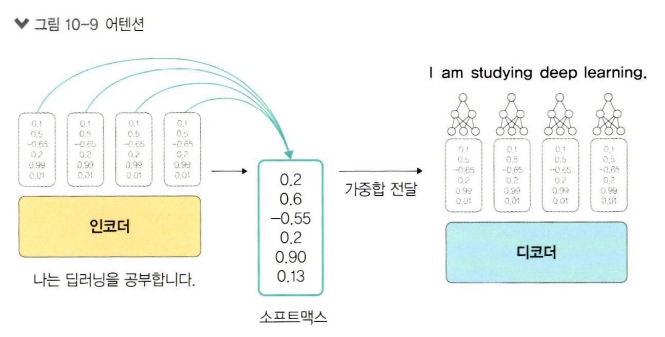

어텐션 (Attention)어텐션 메커니즘은 자연어 처리 및 번역 모델에서 중요한 역할을 한다. 어텐션은 입력 벡터를 인코더에서 변환하고, 변환된 모든 벡터를 디코더로 전송하여 정보 손실 문제를 해결한다. 특히 RNN 기반의 모델들이 겪는 기울기 소실 문제(gradient vanishing problem)를 해결하는 데 주목할 만한 성과를 거뒀다. 어텐션 메커니즘은 입력 시퀀스의 모든 벡터를 전달하기 때문에 행렬 크기가 커지는 문제가 발생할 수 있다. 이를 해결하기 위해 소프트맥스(Softmax) 함수를 사용해 가중합을 구한 후, 그 값을 디코더에 전달하여 계산 비용을 줄인다.디코더는 각 시점에서 중요한 정보를 찾아내고, 은닉 상태에서 중요한 벡터들에 집중한다. 구체적으로 소프트맥스 함수를 통해 각 벡터..